Paskutinį kartą atnaujinta

„Deepfakes“ naudojami juoktis ir dėl daugiau apgaulingų priežasčių. Čia daugiau apie koncepciją ir kodėl tai nėra viskas smagu ir žaidimai.

Kadaise daugiausia apsiriboję pornografija, dabar visur pasirodo gilios klastotės. Dar daugiau nerimo: technologija, kuria remiamasi, kasmet tobulėja, o tai gali turėti plačių pasekmių ateinančiais metais.

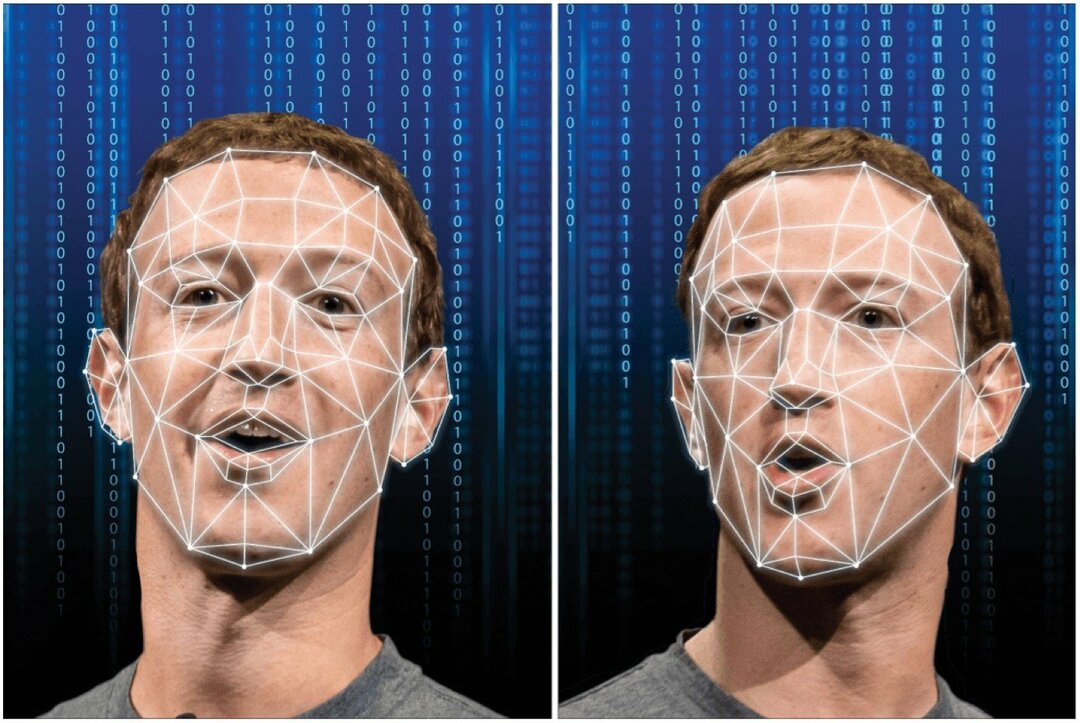

Ar Markas Zuckerbergas tikrai tai pripažino pavogę duomenis iš milijardų žmonių? Ar Barackas Obama paskambino Donaldui Trumpuivisiška nesąmonė?„Kiekviena iš šių vaizdo įrašų nuorodų yra gilios klastotės pavyzdys, pavojinga dirbtinių technologijų forma, leidžianti įdėti žodžius į kieno nors burną ar kitą veidą ant kito žmogaus kūno. Taip pat yra „balso odos“ ir „balso klonai“, kurie leidžia išdaigininkams imituoti balsą.

Aptariant gilias klaidas, verta atsakyti į du klausimus. Pirma, kas juos daro, ir, antra, kodėl jie tapo tokie veiksmingi. Taigi pažvelkime.

„Deepfakes“: Taigi, kokia problema?

Be jokios abejonės, kai kurie giluminiai pokštai yra juokingi - kai tik pajuokauji. Pavyzdžiui, įsivaizduokite, kad 44 -asis JAV prezidentas tikrai viešai pavadino 45 -ąjį blogą vardą arba kad originali „Wonder Woman“, Lynda Carter, kažkaip buvo pastatytas į naujesnius filmus, kuriuose iš tikrųjų vaidino Gal Gadot.

Deja, tobulėjant gilumoms, gali kilti problemų ir sukelti didelių problemų. Pavyzdžiui, politiniai oponentai gali sukurti suklastotus vaizdo įrašus, kuriuose priešininkai atsiduria kompromituojančiose pozicijose. Tai darydami jie galėtų pakeisti rinkimų rezultatus. Pavojingesniu pavyzdžiu įsivaizduokite, kad dabartinis JAV prezidentas, paskelbęs karą Kinijai, ir Kinijos vyriausybė mano, kad tai tiesa.

Problemos, susijusios su giliais sukčiavimais, neturi būti susijusios su įžymybėmis ar vyriausybės pareigūnais. Pvz., Turėdamas „balso odos“ sukčius gali įtikinti tėvą, kad jų vaikas pateko į bėdą, arba netikras IRS agentas gali apgauti nieko neįtariantį pilietį, kad jis perduotų banko informaciją.

Kiti gilių klastotės pavyzdžiai yra sukčiavimo sukčiai, duomenų pažeidimai, reputacijos kenkimas, socialinė inžinerija, automatizuotos dezinformacijos atakos ir finansinis sukčiavimas.

DAVIDAS PAULAS MORRISAS - BLOOMBERGAS/GETTY IMAGES

Kodėl jie veiksmingi?

Giliojo mokymosi technologija pastaraisiais metais pagerino giliųjų klastočių kokybę. Ir vis dėlto yra ir kitų priežasčių, nes faktas ir fikcija tampa vis miglotesni. Pagal Giliai netikras dabar, patvirtinimo šališkumas ir klaidingas įsitikinimas taip pat kenkia mūsų smegenims.

Patvirtinimo šališkumas

Patvirtindami šališkumą, asmenys ieško, interpretuoja ir teikia pirmenybę informacijai taip, kad palaikytų savo įsitikinimus ar vertybes.

Kaip paaiškina Amerikos psichologijos asociacija (APA), „Patvirtinimo šališkumas yra tendencija ieškoti informacijos, kuri palaiko, o ne atmeta savo išankstines nuostatas, paprastai aiškindamas įrodymus, kad patvirtintų esamus įsitikinimus, tuo pačiu atmesdamas arba ignoruodamas bet kokius prieštaringus duomenis “.

Klaidingas tikėjimas

Psichologijoje proto teorija reiškia protinį gebėjimą suprasti kitus žmones ir jų elgesį. Klaidingas įsitikinimas laikomas svarbiu teorijos etapu. Tai supratimas, kad kiti žmonės gali tikėti tuo, kas nėra tiesa.

Grįžkime prie „Deep Fake Now“: „Turėdamas pakankamai laiko, kažkas kažkur neišvengiamai panaudos„ alternatyvius faktus “savo darbotvarkei paremti. Ir jie greičiausiai naudos „deepfake“ technologiją savo teiginiams „įrodyti“. Tai yra jų būdas skleisti abejones ir propagandą visuomenėse “.

Abi sąvokos parodo, kaip giluminiai sukčiavimai naudojami kaip priemonė pakeisti nuomonę.

„Deepfakes“: ar tai tikra, ar netikra?

Nors „deepfakes“ technologija tobulėja, yra būdų, kaip pasakyti, kada vaizdo įrašas yra suklastotas. Tiesą sakant, Nortonas paaiškina, kad jų yra bent jau 15 patikimų būdų nustatyti klastotę. Tarp jų yra:

- Nenatūralus akių judesys. Akių judesiai, kurie neatrodo natūraliai - arba akių judesių trūkumas, pvz., Nemirksėjimas - yra raudonos vėliavos. Sunku pakartoti mirksėjimą taip, kad atrodytų natūraliai. Taip pat sunku pakartoti tikro žmogaus akimirkas. Tai tampa kažkieno akimis, kurios dažniausiai seka žmogų, su kuriuo kalbasi.

- Emocijų trūkumas. Taip pat galite pastebėti veido morfologiją ar įvaizdžio lipdukus, jei neatrodo, kad kažkieno veidas parodytų emocijas, kurios turėtų derėti su tuo, ką jie taria.

- Nenatūrali spalva. Nenormalus odos tonas, spalvos pasikeitimas, keistas apšvietimas ir netinkami šešėliai yra požymiai, kad tai, ką matote, greičiausiai yra suklastota.

- Skaitmeniniai pirštų atspaudai. „Blockchain“ technologija taip pat gali sukurti skaitmeninį vaizdo įrašų pirštų atspaudą. Nors ir nėra patikimas, šis „blockchain“ pagrįstas patvirtinimas gali padėti nustatyti vaizdo įrašo autentiškumą. Štai kaip tai veikia. Sukūrus vaizdo įrašą, turinys registruojamas knygoje, kurios negalima pakeisti. Ši technologija gali padėti įrodyti vaizdo įrašo autentiškumą.

- Atvirkštinės vaizdo paieškos. Ieškant originalaus vaizdo arba atvirkštinio vaizdo paieškos naudojant kompiuterį, galima atrasti panašių vaizdo įrašų internete, kad būtų lengviau nustatyti, ar vaizdas, garsas ar vaizdo įrašas buvo kokiu nors būdu pakeisti. Nors atvirkštinės vaizdo paieškos technologija dar nėra viešai prieinama, investuoti į tokį įrankį gali būti naudinga.

Pavyzdžiai

Internete yra daug gilių klastotės pavyzdžių. Mano asmeniniai mėgstamiausi yra šie:

Kaip matote, „deepfakes“ iš tikrųjų gali būti juokingi, linksmi. Deja, jie taip pat gali būti pavojingi, kai technologija naudojama neteisėtai. Bus įdomu, kur tai bus koncepcija ateinančiais metais.

Kaip išvalyti „Google Chrome“ talpyklą, slapukus ir naršymo istoriją

„Chrome“ puikiai saugo jūsų naršymo istoriją, talpyklą ir slapukus, kad optimizuotų naršyklės našumą internete. Jos būdas ...

Dokumentų bendrinimo „Google“ dokumentuose, skaičiuoklėse ir skaidrėse vadovas

Galite lengvai bendradarbiauti su „Google“ žiniatinklio programomis. Štai jūsų vadovas, kaip bendrinti „Google“ dokumentuose, skaičiuoklėse ir skaidrėse su leidimais ...